[생성모델 시리즈] Adversarial Latent Autoencoders

[생성모델 시리즈] Adversarial Latent Autoencoders

■ 본 논문은, GAN의 Generator → F, G & Discriminator → E, D 각각 분리하여 아키테처를 구성하고 있습니다. ■ F에서 나온 latent space와 E에서 나온 latent space가 서로 동일한 분포를 가진다고 가정해서 연구가 진행 되었으며, F는 deterministic하게 latent space mapping이 이루어지고, G﹒E는 독립적이고 이미 알려진 분포의 noise인 $\eta$를 입력으로 주어 stochastic하게 만듭니다. ■ 결론적으로 latent space의 확률 분포를 adversarial 하게 학습할 수 있는 장점이 있습니다. 그로 인하여 GAN과 비슷한 생성 능력, disentangled representation을 학습한 점을 보여주고 있습..

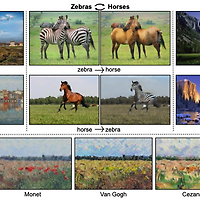

[CycleGAN] Unpaired image-to-image Translation using Cycle-Consistent Adversarial Networks

[CycleGAN] Unpaired image-to-image Translation using Cycle-Consistent Adversarial Networks

1. Abstract Image-to-image translation is a class of vision and graphics problems where the goal is to learn the mapping between an input image and an output image using a training set of aligned image pairs. However, for many tasks, paired training data will not be available. We present an approach for learning to translate an image from a source domain X to a target domain Y in the absence of ..

[Pix2Pix] Image-to-Image Translation with Conditional Adversarial Network

[Pix2Pix] Image-to-Image Translation with Conditional Adversarial Network

1. Abstract image-to-image translation problems에 대한 일반적인 방법부터 Contitional adversarial networks를 사용한 방법까지 조사했다. Image-to-Image translation problems를 다루는 Networks는 입력 이미지에서 출력 이미지로 가는 mapping을 학습할 뿐만 아니라 loss function도 학습한다. 이를 통해 image-to-image translaotion problems에서 각 상황에 따라 사용되는 loss functions이 달랐지만 paper에서 제안한 방식을 적용하면 동일한 loss functions을 사용하여 적용할 수 있다. paper에서 제안한 방법을 사용하면 label maps에서 사진을 합..

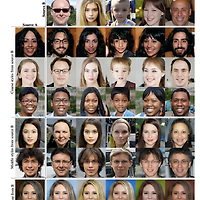

[StyleGAN] A Style-Based Generator Architecture for Generative Adversarial networks

[StyleGAN] A Style-Based Generator Architecture for Generative Adversarial networks

1. Abstract We propose an alternative generator architecture for generative adversarial networks, borrowing from style transfer literature 라고 논문 초반 부분에 나와있다. 해당 논문에의 핵심은, Generator Architecture를 중심적으로 설명하고, 이 Architecture를 기존에 하던 방식(PGGAN)과는 다른 방법으로 구성을 했다라는게 핵심 포인트이다. 또한 Image에 Style을 scale-specific control하게 적용 했다 라고 주장을 하고 있다. 그럼 여기서 Style을 scale-specific control하게 적용한 의미가 무엇인지 한번 짚고 넘어가보자. Q..

[PGGAN] Progressive Growing of GANs for Improved Quality, Stability, and Varation

[PGGAN] Progressive Growing of GANs for Improved Quality, Stability, and Varation

1. Abstract 1-1. Problem PGGAN(Progressive Growing of GANs)은 2017년도에 나온 Nvidia에서 나온 논문이고 발표 당시 큰 이슈를 받았다고 한다. 그 이유는 그 전까지 GAN들은 고해상도(High resolution) 이미지를 만드는것이 매우 힘들었는데 이 논문이 새로운 접근 방법으로 고해상도 이미지 생성하는 것을 해결했다. 일반적인 GAN으로 고해상도 이미지를 만든다고 한다면, 아래와 같은 문제들이 발생을 할 것 이다. - 고해상도 이미지를 만드는 것은 매우 어려운 일이다. 그 이유는, High Resolution 일수록 Discriminator는 Generator가 생성한 Image가 Fake Image인지 아닌지를 구분하기가 쉬워지기 때문이다. - ..

[AnoGAN] Unsupervised Anomaly Detection with GAN 정리

[AnoGAN] Unsupervised Anomaly Detection with GAN 정리

Unsupervised Anomaly Detection with Generative Adversarial Networks to Guide MArker Discovery 일명 "AnoGAN"에 대한 paper을 읽고 정리한 공부자료 입니다. 기본개념 GAN이란? GAN의 학습 과정은, Discriminator가 Real과 Fake를 잘 맞추도록 훈련을 한 다음, Generator가 만들어낸 Fake image가 Discriminator에서 Real로 나오도록 하는 학습 과정입니다. DCGAN - CNN vs MLP MLP : 3차원 데이터를 1개의 Vector로 풀어서 인식한다. 그로인해 단점은 이미지의 위치 정보를 무시하게 된다(feature loss발생) CNN : 3차원 데이터 입력을 그대로 사용한다..

GAN 중에서 가장 기본적인 "Generative Adversarial Network"에 대해 논문을 읽고 참고자료를 본 후 정리한 공부자료 입니다. + 정리하다가 Autoencoder와 VAE 개념을 먼저 알아야 GAN을 이해하기 쉽다는 생각이 들어서 추후에 정리하도록 하겠습니다. GAN을 하기 전에 기본 개념 1. Supervised Learning Supervised Learning에 대한 내용은 자세하게 설명은 안하겠습니다. 우리가 흔히 알고있는 Supervised Learning은 "model이 학습을 할 때 Label data가 존재해야 한다" 라는 것 입니다. 그래서 보통 input data를 알맞은 class로 분류(classification)을 해주는 거로 알고 있습니다. 위에서 보이는 ..