[생성모델 시리즈] Adversarial Latent Autoencoders

[생성모델 시리즈] Adversarial Latent Autoencoders

■ 본 논문은, GAN의 Generator → F, G & Discriminator → E, D 각각 분리하여 아키테처를 구성하고 있습니다. ■ F에서 나온 latent space와 E에서 나온 latent space가 서로 동일한 분포를 가진다고 가정해서 연구가 진행 되었으며, F는 deterministic하게 latent space mapping이 이루어지고, G﹒E는 독립적이고 이미 알려진 분포의 noise인 η를 입력으로 주어 stochastic하게 만듭니다. ■ 결론적으로 latent space의 확률 분포를 adversarial 하게 학습할 수 있는 장점이 있습니다. 그로 인하여 GAN과 비슷한 생성 능력, disentangled representation을 학습한 점을 보여주고 있습..

[StyleGAN] A Style-Based Generator Architecture for Generative Adversarial networks

[StyleGAN] A Style-Based Generator Architecture for Generative Adversarial networks

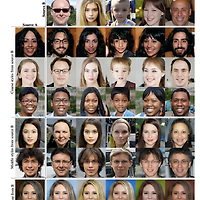

1. Abstract We propose an alternative generator architecture for generative adversarial networks, borrowing from style transfer literature 라고 논문 초반 부분에 나와있다. 해당 논문에의 핵심은, Generator Architecture를 중심적으로 설명하고, 이 Architecture를 기존에 하던 방식(PGGAN)과는 다른 방법으로 구성을 했다라는게 핵심 포인트이다. 또한 Image에 Style을 scale-specific control하게 적용 했다 라고 주장을 하고 있다. 그럼 여기서 Style을 scale-specific control하게 적용한 의미가 무엇인지 한번 짚고 넘어가보자. Q..